「生成AIを医療現場に導入したい」「でも患者情報の院外送信は大丈夫なのか」「ハルシネーションで誤った医療情報が出たらどうする」——2026年現在、医療機関の院長・情報システム担当者・医療事務責任者からこうした相談が急増しています。ChatGPT・Claude・Geminiなどの大規模言語モデル(LLM)が医療現場に本格的に持ち込まれる動きは加速していますが、医療情報の機密性・安全性・規制対応という固有の制約があるなかで、性急な導入は大きなリスクを孕みます。一方、電子カルテ要約・問い合わせ対応自動化・研修資料生成といった事務的業務への活用は、十分な検討のもとで段階的に進めることで、人手不足が深刻化する医療現場の負荷軽減に貢献しうるポテンシャルを持っています。本記事では、厚生労働省・経済産業省・総務省・PMDA等の公開情報をもとに、医療現場での生成AI活用の実態と課題、ガイドライン・規制の整理、セキュリティ設計の考え方、段階的な導入アプローチまでを体系的に整理します。診療判断への生成AI活用は現時点では推奨できず、具体的な導入設計については専門家への相談が不可欠であることを、最初にお伝えしておきます。

この記事で分かること

- 2026年時点の医療×生成AI市場の規模感と国内外の動向

- 厚労省・経産省・総務省・3省2ガイドラインと生成AIの関係

- カルテ要約・予約対応・研修資料生成など現場で想定される活用シーン

- 医療機器プログラム(SaMD)規制とPMDAの動向

- 個人情報保護・院外送信問題の整理ポイント

- 主要LLM・国内医療向けAIサービスの公開情報比較

- オンプレ/プライベートAIとクラウド型AIの選択軸

- 院内ガバナンス設計と利用規程のひな型要素

- ハルシネーション・誤情報生成リスクと失敗事例

- 段階的導入ステップ(事務作業から開始するアプローチ)

- よくある質問(FAQ)10問への回答

1. 医療×生成AI 市場概観(2026年)

生成AIの医療分野への応用は、2023年末から2024年にかけて国内外で急速に拡大しました。米国では2024年に複数の大手病院グループがEHR(電子健康記録)システムとLLMの統合パイロットを公表し、英国NHSでも行政文書作成や患者問い合わせ対応への活用事例が相次ぎ報告されています。

国内においても、2024年度の経済産業省「医療機関等における生成AI活用に関する実態調査」では、回答医療機関の約42%が「生成AIの活用を検討中または試験運用中」と回答しており、前年比で大幅に増加しています(出典:経産省公表資料)。市場規模については、富士経済が2025年に公表した「医療DX関連市場の調査」において、医療向けAIシステム全体の国内市場が2026年に約1,800億円規模に達するとの予測が示されています。

1-1. 国内医療機関の導入状況

2026年現在、国内の医療機関における生成AI活用は「探索・試験段階」が大半を占めています。厚生労働省が2025年に実施した「医療DXの実施状況に関するアンケート調査」では、病院全体の約18%が何らかの生成AIツールを業務に試験的に取り入れていると報告しています。一方、クリニック(診療所)レベルでは普及率はさらに低く、約6%にとどまっています。

活用領域別では、「医事・事務作業の補助(文書作成・翻訳等)」が最多で約65%、「患者向け情報提供・FAQ自動化」が約28%、「医療従事者向けの情報検索・文献サマリー」が約22%となっています。一方、「診断支援・治療方針の補助」への活用は約7%と少数派であり、大部分が診療の周辺業務への活用にとどまっていることが分かります(厚労省、2025年)。

1-2. 医療現場が生成AIに期待する価値

| 期待領域 | 具体的な活用想定 | 現場の主な課題 |

|---|---|---|

| 事務・管理業務の効率化 | 紹介状・サマリー下書き・議事録作成・問い合わせ対応 | 情報漏洩リスク・入力内容の正確性確認 |

| 医療従事者の情報収集支援 | 医学文献の要約・薬剤情報の整理・ガイドライン検索 | ハルシネーション・出典確認の煩雑さ |

| 患者コミュニケーション支援 | 外国語患者向け翻訳・説明文書の平易化 | 翻訳精度・医療用語の誤訳リスク |

| 教育・研修支援 | 症例ベースの学習教材生成・e-ラーニングコンテンツ作成 | 著作権・事例の匿名化処理 |

| 院内業務プロセス改善 | シフト作成支援・施設管理文書の整理 | データ連携・システム統合コスト |

医療現場での生成AI活用が特に注目されている背景には、医師・看護師の慢性的な人手不足と長時間労働問題があります。2024年度から適用された医師の時間外労働上限規制(いわゆる「医師の働き方改革」)のもと、文書作成・情報検索・患者説明資料作成などの付随業務を生成AIで効率化することへの関心が高まっています。厚生労働省「医師の働き方改革の推進について」(2024年)も、タスクシフト・タスクシェアの文脈でICT活用の重要性を強調しています。

2. 厚労省・経産省・総務省ガイドライン(医療情報の二次利用 / 3省2ガイドライン)

医療機関が生成AIを導入・運用するにあたって最初に理解しなければならないのが、「3省2ガイドライン」と呼ばれる規制フレームワークです。これは法律ではなくガイドラインですが、医師法・医療法・個人情報保護法と連動しており、実質的な準拠義務が生じます。生成AIの登場により、このフレームワークの解釈が新たな局面を迎えています。

2-1. 3省2ガイドラインの全体像

| 省庁 | 管轄対象 | 主要ガイドライン名 | 直近改定 |

|---|---|---|---|

| 厚生労働省 | 医療機関(病院・診療所・薬局等) | 医療情報システムの安全管理に関するガイドライン 第6.0版 | 2023年5月 |

| 経済産業省 | 医療情報を扱うシステム・サービス提供事業者 | 医療情報を取り扱う情報システム・サービスの提供事業者における安全管理ガイドライン | 2023年7月 |

| 総務省 | クラウドサービス提供事業者 | クラウドサービス提供における情報セキュリティ対策ガイドライン 第3版 | 2024年1月 |

厚労省ガイドライン第6.0版(2023年5月)は、2021〜2022年の大規模ランサムウェア被害を受けた大幅改定版です。クラウドサービス利用時の責任分担の明確化、バックアップの独立保管義務強化、リスクアセスメントの定期実施義務など、生成AIを含む新技術導入時にも適用される重要な要件が含まれています。

2-2. 生成AIと3省2ガイドラインの交点

生成AIサービスに患者情報を入力する行為は、3省2ガイドラインにおける「クラウドサービスへの情報の委託」に該当する可能性があります。厚労省ガイドライン第6.0版では、「医療情報システムの利用において外部のクラウドサービスを活用する場合、医療機関は当該サービスの安全性を確認する義務がある」と明記されており、次の3点の確認が求められます。

- ISO/IEC 27001・27017・27018の取得状況:クラウド上での情報セキュリティ管理とプライバシー保護の認証

- データ処理の透明性:入力データが学習に利用されるか否か・データの保存場所・保存期間

- 委託先管理の文書化:サービス提供事業者との間で安全管理措置を契約上明確化する

2024年3月、厚生労働省は「医療分野における生成AI等の利活用に関する考え方の整理(素案)」を公表しました。この文書では、生成AIを「診療支援ツール」として位置づける場合と「業務支援ツール」として位置づける場合で、求められる安全管理水準と規制対象が異なると整理されています。現時点では確定的な指針は未整備の部分もあり、厚労省は2026年中の正式ガイドライン改定に向けた検討を継続しています。

2-3. 医療情報の二次利用・研究利用に関するルール

患者データを生成AIのファインチューニング(追加学習)に使用する場合や、医療AIシステムの精度向上に活用する場合は、「医療情報の二次利用」として別途の法的根拠が必要です。次世代医療基盤法(2018年施行、2023年改正)では、医療機関が認定事業者に対して匿名加工医療情報を提供する枠組みが整備されていますが、医療機関の院内システムで使用する生成AIへの患者データ入力については、個人情報保護法の「利用目的の明示」「第三者提供の制限」に関する解釈が2026年現在も議論中です。個人情報保護委員会は2024年のQ&Aにおいて、「生成AIサービスへの個人情報の入力は第三者提供に当たる場合がある」との見解を示しており、医療機関は入力する情報の匿名化・仮名化処理の実施を検討する必要があります。

2-4. 内閣府・デジタル庁の「AI戦略」との関係

日本政府は2024年3月に「AI事業者ガイドライン(第1.0版)」を内閣府・総務省・経済産業省が共同で公表しました。このガイドラインでは「人間中心」「安全性」「公平性」「透明性」「プライバシー保護」「セキュリティ確保」「説明可能性」などのAI利用原則が示されています。医療機関がAI事業者ガイドラインの「利用者・第三者への影響」に関する原則に照らしてリスク評価を行うことが推奨されており、高リスク用途(生命・安全に直結する判断支援)への生成AI活用は特に慎重な検討が求められます。

3. 想定される医療現場での活用シーン

生成AIを医療現場に導入する際には、まず「どの業務に使うか」を明確化することが出発点です。診療判断・治療計画・処方への直接的な活用は現時点では推奨できません。一方で、診療の周辺業務(事務・コミュニケーション支援・教育)への活用は、適切なガバナンスのもとで有望な領域です。

3-1. 電子カルテ記載・要約支援

医師・看護師が診察中・診察後に行うカルテ記載は時間的負荷が大きく、生成AI支援への期待が高い領域です。代表的な活用想定は以下のとおりです。

- SOAP形式の下書き支援:音声入力や箇条書きメモを構造化されたSOAP記載に変換するアシスト

- 退院サマリーの下書き生成:入院中の経過記録を読み取り、退院サマリーの初稿を生成

- 紹介状・返書の下書き作成:定型フォーマットへの情報整理と文章化のアシスト

- 長文カルテの要約:複数回の通院記録を要約し、他職種が素早く把握できる形に整理

ただし、これらの用途には重大な留意点があります。生成AIの出力はあくまで「下書き候補」であり、医師・看護師による確認・修正が必須です。また、患者の個人識別情報(氏名・生年月日・住所・診断名など)を汎用クラウド型LLMに直接入力することは、3省2ガイドラインおよび個人情報保護法の観点から慎重な検討が必要です。院内サーバーで動作するオンプレミス型AIまたはプライベートクラウド型AIの利用が望ましいとされています。

3-2. 患者からの予約・問い合わせ対応の自動化

Web予約システムやLINE公式アカウントと生成AIを連携させ、患者からの問い合わせへの一次対応を自動化する取り組みが2024年から増えています。「診療時間は何時ですか」「初診の予約方法を教えてください」「持参すべき書類は何ですか」など、定型的な問い合わせへの対応に生成AIを活用する場合、患者の個人情報を直接扱わないシナリオでは比較的リスクが低い活用といえます。

一方で、「○○の症状があるがどんな科を受診すればよいか」「△△という薬はどんな副作用があるか」といった医療的判断を含む問い合わせへの自動回答は、誤情報提供のリスクが高く、「医師の診察を受けてください」といった定型文への誘導設計が求められます。受付スタッフへのエスカレーション経路をあらかじめ設けることが重要です。

3-3. スタッフ研修・教育資料の生成

医療機関内の研修資料作成・e-ラーニングコンテンツ生成への活用は、患者の個人情報を扱わないため、汎用クラウド型LLMを利用しやすい領域です。具体的な活用例として、新入職員向けオリエンテーション資料の作成補助・感染対策マニュアルの更新・厚労省通知の要約資料作成・医療法改正対応のQ&A文書生成などが挙げられます。ただし、生成した内容に最新の医学的知見が反映されているか、法改正に対応しているかをあらかじめ担当者が確認・承認するプロセスが不可欠です。

3-4. 診療支援(高リスク領域)への慎重な姿勢

画像診断支援AI・病理診断支援AI・処方チェックAIなど、診療判断に直接関与するAIは、医療機器プログラム(SaMD)として規制対象となる可能性があります。汎用LLMを「診断支援」目的で使用することは、現時点では専門家(医療情報・医事法・薬事規制の専門家)への相談なしに実施すべきではありません。本記事では当該領域の詳細実装手順には立ち入らず、規制の概要整理にとどめます。

4. 医療機器プログラム(SaMD)規制との関係(PMDA動向)

医療現場で生成AIを活用する際、「これは医療機器プログラムに当たるのか」という問いは避けて通れません。日本では薬機法(医薬品・医療機器等法)のもと、プログラムも医療機器として規制されることがあり、その判断機関がPMDA(医薬品医療機器総合機構)です。

4-1. SaMDとは何か

SaMD(Software as a Medical Device:医療機器プログラム)は、ハードウェア医療機器に組み込まれることなく、汎用コンピューター・スマートフォン・クラウドサーバー上で動作し、医療目的(診断・治療・予防・予後予測)を遂行するソフトウェアです。国際医療機器規制当局フォーラム(IMDRF)が策定した定義が国際標準となっており、日本もこの枠組みを採用しています。

PMDAは2021年に「プログラムの医療機器該当性に関するガイダンス」を公表し、プログラムが薬機法の規制対象となる医療機器に該当するかの判断基準を整理しています。大原則は「医療目的を有するか否か」であり、疾病の診断・治療・予防・予後予測・生体情報のモニタリングのいずれかを目的とするプログラムは、原則として医療機器規制の対象となります。

4-2. 生成AIはSaMDに当たるか

汎用LLMを診断支援や治療方針の提案に活用する場合、SaMDに該当する可能性があります。PMDAは2024年の「AIを活用した医療機器の審査に関する考え方(素案)」において、「学習データや推論プロセスの透明性確保」「継続的な学習(Continuous Learning)を行うAIへの対応」「説明可能性(Explainability)の確保」を審査上の重点事項として挙げています。

一方で、「医事・事務的業務の補助」や「医療従事者向けの情報検索・文献要約」を目的とする生成AIシステムは、直接的な診断・治療判断を出力しない限りにおいて、SaMDに該当しない可能性が高いとされています。ただし、境界領域の判断はケースバイケースであり、導入前にPMDA相談窓口(RS戦略相談・事前面談制度)を活用することが推奨されます。

4-3. 国際動向(FDA・欧州MDR)

米国FDA(食品医薬品局)は2023年に「Artificial Intelligence/Machine Learning (AI/ML)-Based Software as a Medical Device Action Plan」の進捗を公表し、継続的学習型AIへの監視強化方針を示しました。欧州ではMDR(EU医療機器規制)のもとでAI医療機器のリスク分類が整理されており、高リスク用途のAIには承認前の厳格な評価が求められています。日本のPMDAも国際整合化を進める方針であり、2025〜2026年にかけての規制アップデートが見込まれます。最新動向はPMDAの公式サイトおよびPMDA Medical Information Service(MIS)で確認することが重要です。

5. 個人情報保護・データの院外送信問題(3省2ガイドライン整合性)

医療機関が生成AIを導入する際の最大の障壁のひとつが「患者の個人情報・要配慮個人情報をどこまで使えるか」という問題です。医療情報は個人情報保護法の「要配慮個人情報」に分類され、通常の個人情報よりも厳格な取り扱いが求められます。

5-1. 要配慮個人情報と医療情報の取り扱い

個人情報保護法(2022年改正、2022年4月施行)では、病歴・診療記録・処方内容・検査結果などは「要配慮個人情報」として定義されており、本人の同意なく取得・第三者提供することが原則禁止されています。生成AIサービスに患者の診療情報を入力することが「第三者提供」に当たるかどうかは、個人情報保護委員会のQ&A(2024年更新版)においても慎重な取り扱いを求める内容が示されています。

5-2. データの院外送信と委託処理の考え方

クラウド型LLMサービスに情報を送信する行為が「委託」に当たる場合(個人情報保護法第24条・25条の委託による例外)、以下の条件を充足する必要があります。

- 委託先(LLMサービス事業者)との間で安全管理に関する契約(DPA:データ処理契約)を締結していること

- 委託先が適切な安全管理措置を実施していることを監督・確認していること

- 委託先が入力データを独自の目的(学習・分析)に利用しないことが契約上担保されていること

- データが保存される国・地域の個人情報保護水準が国内と同等であること(越境移転規制)

OpenAI・Anthropic・Googleなどの主要LLMプロバイダーは、企業向けAPIプランにおいてデータ処理契約(BAA:Business Associate Agreement / DPA)の締結オプションを提供しています。ただし、プロバイダーの利用規約の変更・データ保存地域の変更などが事後に生じる可能性があるため、定期的な確認が必要です。

5-3. 匿名化・仮名化による対応

患者の個人識別情報を除去または仮名化(pseudonymization)したうえで生成AIに入力する方法は、個人情報保護法上のリスクを低減する実践的アプローチです。具体的には、氏名を「患者A」に置換・生年月日を年代区分(例:60代)に変換・住所を都道府県レベルに丸める・診断名は維持しつつ固有名詞を削除するといった処置が考えられます。ただし、匿名化・仮名化の処理自体を自動化する際にも、個人が再特定されるリスクの評価(再特定リスクアセスメント)が求められます。

5-4. 厚労省ガイドラインとの整合チェックポイント

| チェック項目 | ガイドライン根拠 | 対応例 |

|---|---|---|

| AIサービス事業者との安全管理契約締結 | 厚労省GL第6.0版 第6章(委託管理) | DPA/BAAの締結・審査記録保管 |

| データ保存地域の確認 | 厚労省GL第6.0版 第7章(クラウド利用) | 国内または同等水準国のデータセンター確認 |

| 学習利用禁止の確認 | 個人情報保護法第24条・25条 | API利用規約のデータ学習オプトアウト確認 |

| リスクアセスメントの実施・記録 | 厚労省GL第6.0版 第2章(リスク管理) | 年次リスクアセスメントシートの整備 |

| 入力情報の匿名化・仮名化 | 個人情報保護法(要配慮個人情報) | 入力前自動マスキングツールの導入 |

| インシデント発生時の対応手順 | 厚労省GL第6.0版 第8章(インシデント対応) | AI関連インシデント対応フローの文書化 |

6. 主要LLM・国内医療向けAIサービスの公開情報整理

医療機関が生成AIサービスを選定する際に参照できる、主要サービスの公開情報を整理します。なお、以下の情報は各社の公開情報・ドキュメントに基づくものであり、具体的な契約条件・料金・機能は最新の公式情報をあらかじめ確認してください。また、本記事は特定サービスの推奨・順位付けを行うものではありません。

6-1. 主要汎用LLMの医療利用時の留意点

| サービス | 提供元 | 医療向け利用の特徴(公開情報) | データ処理契約 |

|---|---|---|---|

| Azure OpenAI Service(GPT-4シリーズ) | Microsoft | Microsoft HIPAA BAA対象。Azure上のデータは学習に使用しない方針(企業向け)。Azure Health Data Services との連携が可能 | DPA/BAA 締結可(Azureポータル経由) |

| Amazon Bedrock(Claude等) | Amazon Web Services | AWS BAA対象。入力データのモデル学習利用なし(デフォルト)。HIPAA対応ワークロード可 | BAA 締結可 |

| Google Cloud Vertex AI(Geminiシリーズ) | Google Cloud HIPAA BAA対象。Healthcare Natural Language API等の医療特化機能と連携可 | DPA/BAA 締結可 | |

| Claude API(Anthropic) | Anthropic | 企業向けAPIではデータ学習オプトアウト可能。AWS Bedrock経由での利用が国内企業に多い | Anthropic DPA あり |

上記の主要クラウドLLMは、いずれも日本の医療機関向けに限定した専用モデルではなく、汎用モデルを医療用途に活用する形態です。医療特有の専門知識(ICD-10コード・薬剤名・手術術式名等)への精度については、一般業務との使用感で差が生じる場合があります。

6-2. 国内医療向けAIサービスの公開情報

国内の医療向けAIサービスとして、以下のような取り組みが公開情報として確認できます(導入実績・効果の具体的数値については、当サイトでは独自検証・取材をしておらず、各社公表値に依拠しています)。

- NEC「医療向け生成AIソリューション」:院内情報系システムと連携した文書作成支援。クローズド環境での動作を特徴として公表(NEC公式サイト、2025年)

- 富士通「Healthcare AI Platform」:電子カルテベンダーとの連携を視野に入れた院内AIアシスタント機能。オンプレミス・プライベートクラウド対応(富士通公式サイト、2025年)

- NTTデータ「医療DXプラットフォーム」:医療情報・レセプトデータ活用の基盤として生成AI機能を統合する方向性を公表(NTTデータ公式サイト、2025年)

- 電子カルテ各社の生成AI連携機能:ORCA管理機構・電子カルテベンダー各社が2024〜2025年にかけてAIアシスト機能の開発・提供を順次発表

国内ベンダーのサービスは、3省2ガイドライン準拠・院内サーバー完結型・日本語処理への最適化を訴求している点が共通しています。費用・機能・対応電子カルテ種別については、各ベンダーに直接問い合わせて最新情報を取得することが必要です。

7. オンプレ/プライベートAI vs クラウド型AI(医療機関の選択軸)

医療機関が生成AIシステムを選定する際の最も根本的な選択が、「院内完結型(オンプレミスまたはプライベートクラウド)」か「外部クラウド型」かです。この選択は、セキュリティ・コスト・運用負荷・機能の拡張性など複数の軸で異なるトレードオフをもたらします。

7-1. 2方式の特性比較

| 比較軸 | オンプレ/プライベートAI | クラウド型LLM(API利用) |

|---|---|---|

| 患者情報の院外送信 | なし(院内完結) | あり(設定・契約による制御が必要) |

| 3省2ガイドライン対応難易度 | 比較的対応しやすい | 委託管理・DPA締結等が必要 |

| 初期導入コスト | 高い(サーバー・GPU整備が必要) | 低い〜中程度(従量課金) |

| 運用・保守負担 | 自院(またはベンダー委託)が担う | クラウド事業者側が担う部分が多い |

| モデル性能の最新性 | 定期的な更新作業が必要 | プロバイダーが随時更新 |

| カスタマイズ性 | ファインチューニングや自院データ学習が可能 | API経由のプロンプトエンジニアリングが主 |

| スケーラビリティ | ハードウェア増設が必要 | 需要に応じて柔軟に拡張可能 |

| 適した施設規模 | 大規模病院・医療グループ | クリニック〜中小病院 |

7-2. 医療機関規模別の現実的な選択肢

小規模クリニック(外来のみ・スタッフ10名未満):院内サーバーへのAI導入はコスト・運用負担の観点から現実的でないケースが多く、患者個人情報を直接入力しない範囲でのクラウドLLM活用(研修資料作成・問い合わせ対応テキスト作成等)が実用的です。

中規模病院(100〜300床):電子カルテベンダーが提供するAIアシスト機能(院内完結型)を優先的に検討し、業務範囲を段階的に拡大するアプローチが現実的です。クラウドLLMを補助的に利用する場合は、入力する情報の種別を限定し、あらかじめDPAを締結します。

大規模病院・医療グループ:プライベートクラウドやオンプレミスへのLLM展開が現実的な選択肢となります。院内学習データ(匿名化処理済み)を用いたファインチューニングで専門性を高める取り組みも研究・先行事例として報告されています。情報システム部門・法務・コンプライアンス部門の連携体制を整備したうえでの段階的展開が推奨されます。

8. 院内ガバナンス(利用規程・誤情報対策)

生成AIを医療機関に導入する際、技術的な実装と同等かそれ以上に重要なのが「院内ガバナンス」の整備です。利用規程・教育・承認フロー・監査の体制がなければ、技術的に優れたシステムを導入しても安全な運用は困難です。

8-1. 生成AI利用規程の基本要素

厚労省ガイドライン第6.0版および個人情報保護委員会のガイダンスを踏まえ、医療機関の生成AI利用規程に含めるべき基本要素を整理します。具体的な文言・詳細条件については、医療情報・法務の専門家の確認を得てください。

- 利用目的の限定:使用を認める業務の種別を明確に列挙し、診療判断への単独利用を原則禁止

- 入力情報の制限:患者の氏名・生年月日・住所・保険証番号等の直接識別情報の入力禁止を明記

- 出力の確認義務:AIが生成したすべての出力は、担当職員が内容を確認・承認した後でのみ使用

- 使用可能サービスのホワイトリスト:承認された生成AIサービスのみを業務使用可能と明記

- ログの保存:業務利用における入出力ログの保存期間・保存方法・アクセス権限

- インシデント報告義務:AIの誤情報に気づいた場合・患者への不適切な情報提供が疑われる場合の報告経路

- 定期レビュー:利用規程の見直し頻度(少なくとも年1回)と改訂手順

8-2. 職種別の教育・リテラシー向上

生成AIの適切な利用には、職種ごとの教育プログラムが不可欠です。医師・看護師・薬剤師・医療事務・情報システム担当者では、生成AIとの関わり方・リスクの種類・対処方法が異なります。最低限の共通教育として「ハルシネーションとは何か・どう対処するか」「入力してはいけない情報の種類」「出力を鵜呑みにしないための確認方法」の3点は全職員に周知することが重要です。

8-3. 誤情報対策(ハルシネーション対策)の組織的取り組み

生成AIの最大の技術的リスクのひとつがハルシネーション(事実と異なる情報の自信を持った生成)です。医療現場では、薬剤名・用量・禁忌・手術手技・法令の数字・診療報酬点数など、誤りが直接的な被害につながり得る情報が多数存在します。組織的なハルシネーション対策として以下が推奨されます。

- RAG(Retrieval Augmented Generation)の活用:院内の承認済み文書(マニュアル・ガイドライン・添付文書等)を検索して回答根拠とするRAG構成を採用し、根拠のない生成を抑制する

- 高リスク情報の出力禁止設定:具体的な処方量・検査値の解釈・手術適応判断などは出力しないようシステム側でガードレールを設定する

- ダブルチェックの義務化:生成AIが出力した数値・法令情報・薬剤情報は、あらかじめ公式ソース(添付文書・厚労省通知等)と照合してから使用する運用ルールを定める

- 誤情報報告の仕組み:スタッフが生成AIの誤りを発見した場合に報告するチャネルを設け、定期的に事例を収集・フィードバック

9. 失敗事例・運用上の注意(ハルシネーション・誤った医療情報生成リスク)

生成AIの医療現場での活用をめぐっては、国内外で様々なリスク事例・注意事項が報告されています。以下は公開情報をもとに整理した代表的な問題パターンです。

9-1. 薬剤情報のハルシネーション

汎用LLMに「○○の薬の副作用・用量を教えてください」と問い合わせると、学習データの偏りや知識の古さにより、正確な添付文書情報とは異なる内容が生成されることがあります。特に、承認年度が新しい薬剤・日本国内のみで承認されている薬剤・後発医薬品の情報は、学習データが不十分で精度が低い傾向が報告されています。2024年に医療情報システム学会が公表した調査では、複数の汎用LLMに対する薬剤情報の問い合わせテストにおいて、一定の割合で添付文書と矛盾する回答が確認されたと報告されています。

9-2. 診療報酬・制度情報の誤情報

診療報酬の点数・算定要件・届出基準などは、改定のたびに変更されます。生成AIの学習データには最新の改定が反映されていない場合があり、廃止された算定要件や古い点数を自信を持って回答するケースが報告されています。2024年度診療報酬改定(2024年6月施行)などの直近改定は、多くの汎用LLMの学習データカットオフ後の情報であり、特に注意が必要です。診療報酬関連の情報は、厚生労働省保険局が公表する「診療報酬の算定方法」告示および通知を正式ソースとしてあらかじめ確認する運用が求められます。

9-3. 個人情報の意図せぬ入力・漏洩リスク

業務の中で「手軽に使える」ツールとして生成AIを使い始めると、スタッフが無意識のうちに患者の氏名・診断名・保険証番号などを含む文章をそのまま入力してしまうリスクが生じます。これは技術的な問題ではなく、運用・教育の問題です。2024年には複数の国内組織で「ChatGPTに社内機密情報を入力してしまった」事案が報告されており、医療機関においても同様のリスクは高いと考えられます。利用規程の徹底と定期的な入力ログ監査が不可欠です。

9-4. AIへの過信による確認省略

「AIが言うなら正しいだろう」という心理的バイアスにより、本来行うべき確認作業を省略してしまう「自動化バイアス」は、航空・金融分野の自動化システムでも広く報告されている問題です。医療現場でも同様のリスクがあり、特に多忙な業務環境下では「AIの出力をそのまま使う」慣習が定着する危険性があります。AIツールの導入段階から「AIの出力はあらかじめ人間が確認する」という文化を組織に根付かせる取り組みが重要です。

9-5. ベンダーロック・システム依存リスク

特定の生成AIサービスに業務を依存しすぎると、サービス終了・価格改定・利用規約変更・API仕様変更が発生した際に業務継続に支障をきたすリスクがあります。医療機関では特に、診療継続性(BCP:事業継続計画)の観点から、特定ベンダーへの過度な依存を避ける設計が重要です。代替手段の確保・ローカル保存可能な形式でのデータ管理・契約更新時の条件交渉の余地確保が推奨されます。

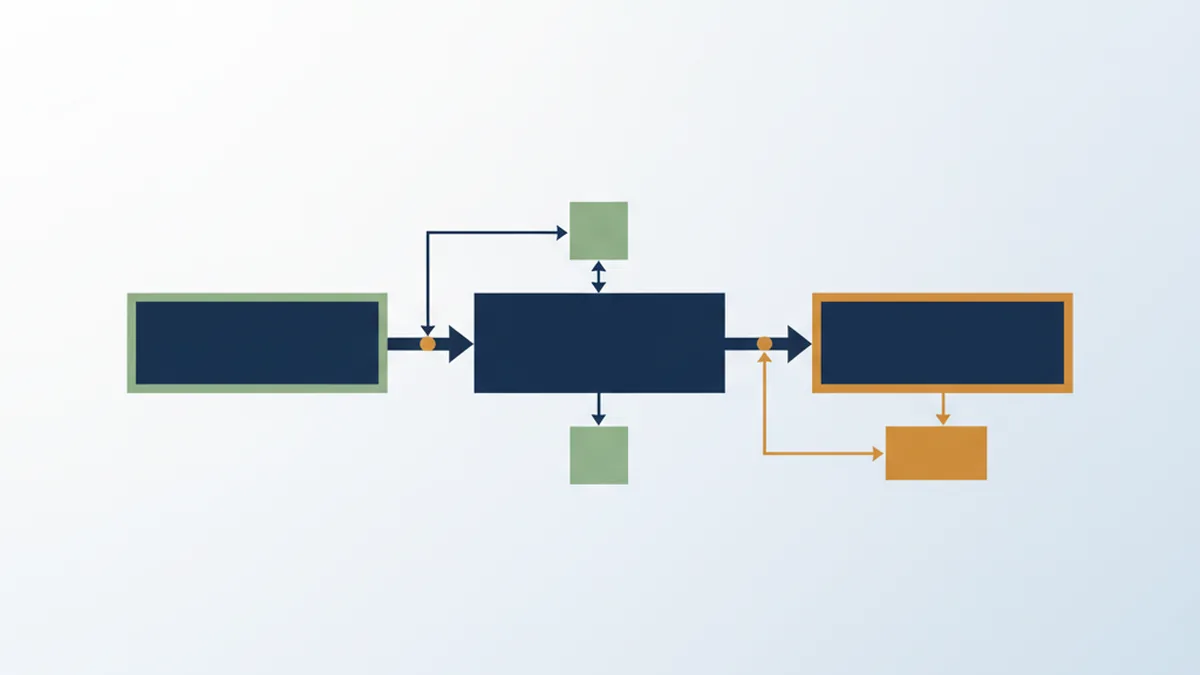

10. 段階的導入アプローチ(事務作業から開始)

医療現場への生成AI導入は、リスクの低い業務領域から段階的に拡大していくことが現実的かつ安全です。以下に推奨される段階的アプローチを示します。

10-1. フェーズ1:患者情報を扱わない事務作業(リスク:低)

最初のステップとして、患者の個人情報・要配慮個人情報を一切扱わない事務作業から開始します。この範囲ではクラウド型LLMを比較的低リスクで利用できます。

- 研修資料・院内マニュアルの下書き作成

- 厚労省通知・診療報酬改定資料の要約(最終確認は担当者が実施)

- 求人票・院内広報文書の文章作成補助

- 外部向けウェブサイトの文章校正・翻訳補助

- スタッフ会議の議事録整理(会議内容を入力する場合は氏名等を除去)

10-2. フェーズ2:仮名化・限定情報での業務補助(リスク:中)

フェーズ1で利用規程・ログ管理・スタッフ教育の運用が軌道に乗った後、患者情報を仮名化・匿名化した形での業務補助に拡大します。このフェーズでは、個人情報保護担当者・システム担当者との連携のもとで入力情報の管理手順を整備します。

- 症例の匿名化処理後における退院サマリーの下書き補助

- 患者向け一般説明文書の生成(特定患者への適用は医師が個別確認)

- 外来問い合わせ対応の定型文生成(個人情報を含まない一般的FAQ)

10-3. フェーズ3:院内完結型AIの検討(リスク:要設計)

フェーズ2で十分な実績と知見が蓄積された後、院内完結型(オンプレミスまたはプライベートクラウド)の生成AIシステムの導入を検討します。このフェーズでは、情報システム部門・電子カルテベンダー・AI専門事業者・法務担当者の連携が不可欠です。SaMD規制の確認・3省2ガイドライン準拠の設計・セキュリティアセスメントは、専門家の関与のもとで実施してください。

10-4. 段階的導入のチェックリスト

| フェーズ | 実施項目 | 担当 |

|---|---|---|

| 準備(全フェーズ共通) | 生成AI利用規程の策定・承認 | 管理者・法務・情報システム |

| 準備(全フェーズ共通) | 全スタッフへのリテラシー教育(ハルシネーション・入力禁止情報) | 管理者・教育担当 |

| フェーズ1開始前 | 使用サービスのDPA/利用規約確認 | 情報システム・管理者 |

| フェーズ1開始前 | 入力ログ保存・監査体制の整備 | 情報システム |

| フェーズ2移行前 | 個人情報保護担当者による匿名化手順審査 | 個人情報保護担当・情報システム |

| フェーズ2移行前 | リスクアセスメントの実施・記録 | 情報システム・管理者 |

| フェーズ3移行前 | SaMD該当性の確認(必要に応じてPMDA相談) | 専門家(医療情報・薬事) |

| フェーズ3移行前 | 3省2ガイドライン準拠設計の確認 | 専門家・情報システム |

11. FAQ(よくある質問)10問

Q1. ChatGPTやClaudeを業務で使っても法律的に問題ないですか?

汎用LLMを「患者の個人情報・要配慮個人情報を含まない業務」に使用する場合、個人情報保護法上の問題は生じにくいといえます。ただし、医療機関としての情報管理規程・利用規程を整備したうえで、承認された範囲での使用に限定することが重要です。患者情報を含む業務への利用は、DPA(データ処理契約)の締結・匿名化処理・3省2ガイドラインへの対応が必要であり、専門家への相談を推奨します。

Q2. 電子カルテのデータを生成AIに入力していいですか?

電子カルテデータは要配慮個人情報を含むため、汎用クラウドLLMへの直接入力は原則として推奨できません。入力が業務上必要な場合は、①個人識別情報の除去(仮名化・匿名化)、②DPA締結済みサービスの使用、③厚労省ガイドライン準拠の安全管理措置の実施、④医療機関の利用規程への明記、の4点を充足する必要があります。詳細な設計は個人情報保護・医療情報の専門家と連携して検討してください。

Q3. 生成AIが診断を「間違えた」場合、誰が責任を負いますか?

現時点の法的解釈では、生成AIを診療判断に活用した場合の責任は、当該判断を行った医師にあると考えられています。AIはあくまで補助ツールであり、最終的な医療判断の責任は医師が負います。このことは、診療判断への生成AI活用が現時点では慎重に検討すべき理由でもあります。医療AIの責任論については、日本医師会・厚労省・法務専門家による議論が継続中であり、今後の動向に注目が必要です。

Q4. 小規模クリニックでも生成AIを活用できますか?

患者情報を扱わない業務範囲であれば、小規模クリニックでも今すぐ活用を始められます。研修資料作成・院内FAQ文書の作成・ウェブサイト用の一般的な健康情報の文章補助などは、汎用クラウドLLMで対応可能です。費用面でも、多くのサービスが従量課金またはサブスクリプション形式で提供されており、初期投資が低い点は小規模施設にとっての利点です。

Q5. 生成AIが作った文書は著作権上問題になりますか?

生成AIが作成した文書の著作権については、2025年現在、日本でも国際的にも整理が進んでいます。文化庁は2024年に「AIと著作権に関する考え方について(素案)」を公表しており、AIが自律的に生成したコンテンツは著作権法上の「著作物」に該当しない可能性があるとする一方、人間の創作的貢献が加わる場合は保護対象となりうるとの見解を示しています。業務で生成したコンテンツについては、あらかじめ人間が内容を確認・修正し、最終的な責任を医療機関として担う体制が重要です。

Q6. 生成AIの医療利用に関するガイドラインは今後変わりますか?

変わります。厚生労働省は「医療分野における生成AI等の利活用に関する考え方の整理」を継続して検討中であり、2026年中の正式ガイドライン改定が見込まれています。内閣府AI戦略・PMDAのSaMD審査基準・個人情報保護委員会のガイダンスも随時更新されるため、医療機関は厚労省・経産省・総務省・PMDAの公式サイトおよびメルマガを定期的に確認する体制を整備してください。

Q7. 患者向けチャットボットに生成AIを使っても良いですか?

診療予約・診療時間・アクセスなど一般的な情報案内目的であれば、適切な設計のもとで活用できます。ただし、「どんな症状なら受診すべきか」「この薬は△△に効きますか」といった医療的判断を含む問い合わせへの自動回答は、誤情報提供・医師法上の問題が生じる可能性があります。医療的判断を含む問い合わせは受付スタッフ・医師にエスカレーションする導線をあらかじめ設けてください。

Q8. スタッフが個人の判断で生成AIを使い始めています。どうすれば良いですか?

まず利用規程を策定・周知し、使用を認めるサービス・業務範囲・入力してはいけない情報を明確に定めます。「禁止」だけでは解決しにくいため、「安全に使える範囲・使い方」を同時に提示することが実効的です。利用規程違反に対する対応方針も明記し、管理者承認のもとで使用できる環境を整備する方が、非公式な利用を減らすうえでも有効です。定期的な研修と利用ログ監査を通じて、継続的な管理を行ってください。

Q9. 医療事務スタッフが生成AIで文書作成を始める場合、最初に何を準備すべきですか?

①利用規程(使用可能サービス・入力禁止情報・確認手順の明記)②最低限のリテラシー教育(ハルシネーションとは何か・出力を鵜呑みにしない確認方法)③使用サービスのDPA・利用規約確認の3点が最初の準備として重要です。フェーズ1(患者情報を扱わない業務から開始)のアプローチで段階的に運用範囲を拡大することを推奨します。

Q10. 生成AIの医療利用でIT補助金は使えますか?

中小企業デジタル化推進に関するIT導入補助金(経産省所管)は、医療機関も対象となる場合があります。ただし、補助金の採択条件・対象経費・申請時期は毎年度変更されるため、最新の公募要領を中小機構・IT導入補助金事務局の公式サイトで確認することが必要です。また、医療機関の設立形態(医療法人・個人開業等)により補助金の利用可否が異なる場合があります。具体的な申請については、中小機構の相談窓口または認定支援機関にご相談ください。

12. まとめ・次の1ステップ

本記事では、2026年時点の医療現場における生成AI活用の全体像を、公的機関の情報をもとに整理しました。要点を振り返ります。

- 医療×生成AIの国内市場は急成長しているが、医療機関の本格導入はまだ「試験・探索段階」が大半

- 3省2ガイドライン(厚労省・経産省・総務省)への対応が生成AI導入の前提要件

- 患者の要配慮個人情報を汎用クラウドLLMに入力する際は、DPA締結・匿名化処理・ガイドライン準拠が必要

- 診断支援・治療判断支援への生成AI活用はSaMD規制の確認が必須であり、専門家への相談なしの実施は推奨しない

- 導入はリスクの低い「患者情報を扱わない事務作業」から段階的に開始するアプローチが現実的

- ハルシネーション・誤情報・自動化バイアスへの組織的対策が技術的実装と同等に重要

- 院内ガバナンス(利用規程・教育・ログ管理・インシデント報告)の整備が長期的な安全運用の基盤

次の1ステップとして、まず自院の「生成AI利用規程(ドラフト)」の策定に着手することを推奨します。利用規程には、①使用を認めるサービスのリスト、②入力してはいけない情報の明示、③出力の確認・承認手順、④インシデント報告経路の4点を最低限盛り込んでください。ガイドライン対応の具体的な設計については、医療情報・個人情報保護・薬事規制の専門家への相談を組み合わせながら進めることが重要です。

出典・参考資料

- 厚生労働省「医療情報システムの安全管理に関するガイドライン 第6.0版」(2023年5月)

https://www.mhlw.go.jp/stf/shingi/0000516275_00006.html - 経済産業省「医療情報を取り扱う情報システム・サービスの提供事業者における安全管理ガイドライン」(2023年7月)

https://www.meti.go.jp/policy/it_policy/privacy/iryou_guideline.html - 総務省「クラウドサービス提供における情報セキュリティ対策ガイドライン 第3版」(2024年1月)

https://www.soumu.go.jp/main_content/000752547.pdf - 内閣府・総務省・経済産業省「AI事業者ガイドライン(第1.0版)」(2024年3月)

https://www.meti.go.jp/press/2024/03/20240319004/20240319004.html - PMDA「プログラムの医療機器該当性に関するガイダンス」(2021年)

https://www.pmda.go.jp/files/000244784.pdf - 個人情報保護委員会「生成AIサービスの利用に関するQ&A」(2024年更新版)

https://www.ppc.go.jp/ - 厚生労働省「医師の働き方改革の推進について」(2024年)

https://www.mhlw.go.jp/stf/seisakunitsuite/bunya/kenkou_iryou/iryou/Quality/index.html - デジタル庁「デジタル社会の実現に向けた重点計画」(2025年)

https://www.digital.go.jp/policies/priority-policy-program/ - 情報処理推進機構(IPA)「情報セキュリティ10大脅威 2024(組織編)」

https://www.ipa.go.jp/security/10threats/10threats2024.html

最終更新日:2026-05-08

【免責事項】本記事は公開情報をもとにした情報提供を目的としており、医療・法律・税務・投資に関する個別の専門的助言を提供するものではありません。生成AIの医療機関への導入に際しては、医療情報・個人情報保護・薬事規制に関する専門家にご相談ください。記載内容は2026年5月時点の公開情報に基づいており、法令・ガイドラインの改定により内容が変更になる場合があります。

【編集方針】本記事は公的機関(厚生労働省・経済産業省・総務省・PMDA・個人情報保護委員会等)の公開情報を一次出典として作成しています。医療行為・診断・治療の助言は行いません。比較・選び方・費用相場・制度情報の整理を中心とし、出典を明示した客観的な情報提供を心がけています。内容に誤りを発見した場合はお問い合わせフォームよりご連絡ください。

関連記事

- 3省2ガイドライン完全対応ガイド【医療機関向け・チェックリスト付き】

- 医療機関向けサイバー保険の比較と選び方【2026年版】

- 医療機関のランサムウェア対策ガイド【感染経路・BCP・主要ツール比較】

- 医療機関のインシデント対応ガイド【初動対応・報告義務・復旧手順】

mitoru編集部の見解

医療情報セキュリティは、医療情報システム安全管理ガイドライン6.0版(厚労省)と医療情報を取り扱う情報システム・サービス提供事業者ガイドライン(経産省・総務省)の3省2ガイドライン準拠が出発点です。ランサムウェア対策はバックアップ・多要素認証・ネットワーク分離の3点セットを最低限満たしてください。